Model Context Protocol (MCP): Oltre l'Hype – L'Analisi Strategica e Architettonica di Architetture Digitali

Nel dinamico universo dell'Intelligenza Artificiale Generativa, l'efficienza è diventata la nuova frontiera. Mentre i Large Language Models (LLM) raggiungono capacità sbalorditive, la gestione dei loro "contesti" – l'enorme quantità di informazioni che devono processare per generare risposte coerenti e pertinenti – si sta rivelando un tallone d'Achille tanto costoso quanto complesso. Ogni interazione, specialmente quelle che richiedono lunghe conversazioni o l'analisi di documenti estesi, implica spesso un re-processing ridondante di dati già visti, con un impatto diretto su latenza e costi operativi.

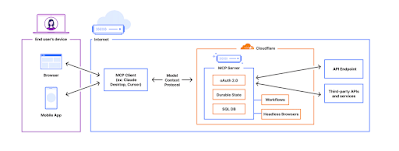

È in questo scenario che emerge l'acronimo Model Context Protocol (MCP). Proposto da attori chiave come Anthropic e riecheggiato in iniziative specifiche come quella di AWS, MCP si candida come una potenziale soluzione per razionalizzare questa inefficienza cronica. Ma cos'è esattamente? È già una realtà tangibile? E, soprattutto, quali sono le sue implicazioni concrete per chi, come noi architetti digitali, progetta e costruisce le fondamenta dei sistemi AI di domani?

In questo approfondimento di "Architetture Digitali", andremo oltre gli annunci e le speculazioni. Effettueremo un'analisi lucida e strategica del Model Context Protocol, distinguendo il concetto dalle sue prime incarnazioni, valutandone lo stato attuale senza filtri e, soprattutto, dissezionando le profonde implicazioni architetturali che questa idea – se dovesse affermarsi – comporterebbe. Il nostro obiettivo è fornirvi non solo conoscenza, ma una bussola strategica per navigare questa potenziale evoluzione dell'ecosistema AI.

Il Cuore del Problema: L'Insostenibile Costo del Contesto negli LLM

Per comprendere appieno la raison d'être di MCP, dobbiamo prima afferrare la natura del problema che cerca di risolvere. Gli LLM moderni, per mantenere la coerenza e la rilevanza durante una conversazione o l'elaborazione di un compito complesso, necessitano di accedere a un "contesto" che può includere l'intera cronologia della chat, documenti forniti, istruzioni specifiche e altro ancora.

Il meccanismo predominante oggi, specialmente per le API stateless, prevede che l'intero contesto venga inviato e rielaborato dal modello ad ogni singolo turno di interazione (prompt/completion). Questo approccio, sebbene semplice da implementare inizialmente, presenta svantaggi critici che diventano esponenziali all'aumentare della lunghezza del contesto:

Costi Computazionali: Meccanismi come l'attenzione self-attention, cuore di molti Transformer, hanno una complessità computazionale che scala quadraticamente (o quasi) con la lunghezza della sequenza. Rielaborare migliaia o decine di migliaia di token ripetutamente consuma enormi risorse di calcolo.

Latenza: Il tempo necessario per processare contesti lunghi aumenta significativamente la latenza percepita dall'utente finale, compromettendo l'esperienza d'uso in applicazioni real-time.

Costi Economici: I provider di API LLM tipicamente tariffano in base al numero di token processati (sia in input che in output). Rielaborare continuamente lo stesso contesto gonfia i costi, rendendo insostenibili applicazioni che richiedono interazioni prolungate su grandi moli di dati. Anthropic stessa, nel suo annuncio di MCP datato [Verificare data annuncio, es. Maggio 2024], evidenzia come questo re-processing ridondante sia uno spreco significativo di risorse.

Decodificare il Model Context Protocol: L'Idea Fondamentale

Di fronte a queste sfide, la proposta del Model Context Protocol (MCP), come articolata da Anthropic, si basa su un'idea concettualmente elegante: separare il processamento del contesto (spesso statico o a lenta variazione) dal processamento del prompt (dinamico e specifico dell'interazione corrente).

Immaginate di poter inviare il contesto (es. un lungo documento PDF) al modello una sola volta. Il modello (o un sistema ad esso associato) lo elabora e ne estrae uno stato interno compatto, una sorta di "rappresentazione contestuale" pre-calcolata. Nelle interazioni successive, invece di inviare nuovamente l'intero documento, si invierebbe solo il nuovo prompt insieme a un riferimento (un "handle" o "ID di contesto") a quello stato pre-calcolato. Il modello utilizzerebbe questo stato per generare la risposta, evitando la costosa rielaborazione dell'intero contesto originale.

È un po' come una cache molto sofisticata e stateful, specificamente progettata per lo stato interno dei modelli Transformer. L'obiettivo è chiaro: massimizzare l'efficienza computazionale e ridurre drasticamente i costi e la latenza per interazioni contestuali lunghe.

Distinguere Concetto, Proposta e Implementazione: Facciamo Chiarezza

È cruciale, in questa fase, fare distinzioni nette per non cadere in equivoci:

MCP come Concetto/Proposta (Anthropic): Questa è l'idea fondamentale di separare contesto e prompt, come proposto da Anthropic nel [Anno Annuncio]. È una visione e una call for collaboration per definire potenzialmente un protocollo standard che permetta questa interazione efficiente tra client e modelli AI. Allo stato attuale ([Anno Corrente]), non sembra esistere una specifica tecnica dettagliata e pubblicamente ratificata del protocollo "MCP" a livello industriale.

MCP come Potenziale Standard Futuro (Visione Ars Technica): L'articolo di Ars Technica (con la sua data URL sospetta del 2025) interpreta questa idea come il seme di un futuro standard universale, paragonandolo all'impatto di USB-C. Questa è una visione speculativa che sottolinea il potenziale impatto, ma non riflette necessariamente lo stato attuale di sviluppo o adozione.

Implementazioni Specifiche (AWS MCP Servers): L'annuncio di AWS sui "MCP Servers" per Code Assistants rappresenta un'iniziativa concreta di un vendor. Sebbene probabilmente ispirata dagli stessi principi di efficienza contestuale, si tratta di una soluzione tecnologica specifica, legata all'ecosistema AWS (Inferentia, Trainium) e focalizzata su un caso d'uso (coding). Non è chiaro se utilizzi internamente un protocollo aderente alla proposta di Anthropic o se "MCP" sia qui (anche) un nome di prodotto. È un esempio di come i singoli player stiano affrontando il problema, ma non equivale all'esistenza di uno standard universale MCP.

Quindi, a che punto siamo realmente? Allo stato attuale ([Anno Corrente]), il Model Context Protocol è meglio inteso come una proposta promettente e un'area di ricerca e sviluppo attiva, guidata da attori come Anthropic, con implementazioni proprietarie emergenti (AWS) che affrontano problemi simili. La strada verso uno standard industriale condiviso è ancora probabilmente lunga e richiederà collaborazione e consenso tra i principali attori dell'ecosistema AI.

I Protagonisti e la Spinta verso l'Efficienza

Anthropic: Chiaramente il promotore più esplicito del concetto di MCP come potenziale standard aperto. La loro motivazione è allineata alla loro ricerca sull'efficienza e la scalabilità degli LLM (come la famiglia Claude con ampie finestre di contesto).

AWS: Con i suoi "MCP Servers", dimostra un interesse concreto nel risolvere il problema dell'efficienza contestuale, almeno per specifici casi d'uso e all'interno del proprio ecosistema cloud. Questo indica che il problema è sentito a livello industriale.

Altri Player (Potenziali): È logico aspettarsi che altri grandi provider di modelli (Google, OpenAI, Meta) e piattaforme cloud (Azure, GCP) stiano esplorando soluzioni simili o siano interessati a partecipare a eventuali sforzi di standardizzazione. L'efficienza è un driver universale. La menzione di "rivali che collaborano" (Ars Technica) suggerisce che potrebbero esserci discussioni in corso dietro le quinte.

La sfida principale per la standardizzazione risiede nella complessità tecnica (definire API, formati di stato, meccanismi di sicurezza) e nella volontà dei diversi attori di convergere su un approccio comune anziché favorire soluzioni proprietarie.

Implicazioni Architetturali: Come MCP Potrebbe Rimodellare i Sistemi AI (Il Cuore dell'Analisi "Architetture Digitali")

Qui entriamo nel vivo della nostra analisi. Se un concetto come MCP dovesse prendere piede, quali sarebbero le conseguenze concrete sulla progettazione e l'implementazione dei sistemi AI?

1. Un Nuovo Layer nello Stack di Inferenza: Il "Context Manager"?

L'idea di separare la gestione del contesto suggerisce la potenziale nascita di un nuovo componente o servizio dedicato all'interno dello stack AI. Potremmo immaginare un "Context Manager" responsabile di:

Ricevere e processare il contesto iniziale.

Memorizzare in modo efficiente e sicuro lo stato contestuale pre-calcolato.

Fornire handle/ID per accedere a questi stati.

Gestire il ciclo di vita dello stato (creazione, aggiornamento incrementale?, invalidazione, garbage collection).

Interfacciarsi con il modello LLM vero e proprio per le inferenze basate su prompt + stato contestuale.

2. Evoluzione delle API dei Modelli: Verso Interfacce "Stateful" o "Context-Aware"

Le attuali API LLM sono prevalentemente stateless. MCP richiederebbe un cambiamento significativo:

Nuovi endpoint per creare/gestire sessioni contestuali.

Metodi per inviare prompt associati a un ID di contesto esistente.

Potenziali meccanismi per aggiornare o aggiungere informazioni al contesto senza rielaborare tutto da capo (aggiornamento incrementale).

3. Complessità nella Gestione dello Stato del Contesto

Questo nuovo layer di stato introduce nuove sfide architetturali:

Caching e Invalidazione: Come garantire che lo stato contestuale rimanga valido e coerente, specialmente se i dati sottostanti cambiano?

Sicurezza e Isolamento: Lo stato contestuale può contenere dati sensibili. Come garantirne la sicurezza, l'isolamento tra tenant (in scenari multi-utente) e la compliance normativa (es. GDPR)?

Scalabilità e Persistenza: Come scalare il servizio di gestione del contesto per gestire migliaia o milioni di sessioni contemporaneamente? Dove e come persistere questi stati?

Costo dello Storage: Memorizzare molti stati contestuali, anche se compatti, introduce un nuovo costo di storage da considerare.

4. Ottimizzazione Hardware/Software Specifica

L'elaborazione iniziale del contesto e la gestione efficiente dello stato potrebbero beneficiare di acceleratori hardware (come Inferentia/Trainium di AWS) o ottimizzazioni software specifiche, creando potenziali nuove aree di specializzazione tecnologica.

5. Posizionamento rispetto a Tecniche Esistenti: MCP vs RAG

È importante non confondere MCP con Retrieval-Augmented Generation (RAG).

RAG: Recupera dinamicamente pezzi di informazione rilevanti da una base di conoscenza esterna (vettoriale o altro) e li inserisce nel contesto inviato al modello ad ogni chiamata. RAG riduce la quantità di contesto statico da inviare, ma non elimina il re-processing del contesto selezionato ad ogni turno.

MCP: Si concentra sull'evitare il re-processing del contesto (che potrebbe anche essere stato recuperato tramite RAG) una volta che è stato elaborato la prima volta.

I due approcci sono potenzialmente complementari: si potrebbe usare RAG per selezionare le informazioni pertinenti e poi MCP per gestire efficientemente quel contesto selezionato attraverso più turni di interazione.

La Prospettiva Strategica di Architetture Digitali: Navigare l'Incertezza con Pragmatismo

Data la natura emergente e ancora non standardizzata di MCP, come dovrebbero posizionarsi gli architetti digitali? Proponiamo un approccio pragmatico basato su questo framework preliminare:

Monitorare Attivamente, Non Adottare Acriticamente: Tenete d'occhio gli sviluppi di MCP, gli annunci dei principali player (Anthropic, Google, OpenAI, AWS, Azure...) e gli eventuali progressi verso la standardizzazione. È rilevante soprattutto se sviluppate applicazioni con:

Interazioni LLM lunghe e conversazionali.

Analisi ripetute su grandi documenti o codebase.

Requisiti stringenti di bassa latenza e/o controllo dei costi su larga scala.

Focalizzarsi sui Principi Architettonici Fondamentali: Indipendentemente da MCP, progettare sistemi AI modulari, con API ben definite e disaccoppiamento tra i componenti vi renderà più resilienti e pronti ad adottare future ottimizzazioni (che sia MCP o altro). Isolare la logica di interazione con l'LLM è una buona pratica a prescindere.

Valutare Soluzioni Vendor-Specific con Cautela: Soluzioni come AWS MCP Servers possono essere valide se siete già fortemente integrati in quell'ecosistema e il caso d'uso specifico (es. code assistant) è perfettamente allineato. Siate però consapevoli del potenziale vendor lock-in rispetto a un futuro standard aperto.

Sperimentare con Tecniche di Ottimizzazione Esistenti: Non aspettate MCP per affrontare i problemi di contesto. Ottimizzate i prompt, utilizzate RAG efficacemente, esplorate tecniche di caching a livello applicativo, e scegliete modelli con la finestra di contesto appropriata (non necessariamente la più grande possibile).

Contribuire alla Discussione (se pertinente): Se la vostra organizzazione ha esigenze significative in quest'area, considerate di partecipare a eventuali gruppi di lavoro o iniziative di standardizzazione che dovessero emergere.

Il Model Context Protocol rappresenta una direzione promettente per affrontare una sfida reale e crescente nell'ecosistema AI. Tuttavia, è fondamentale mantenere una prospettiva critica, distinguere l'hype dalla realtà tangibile e concentrarsi sulle implicazioni architetturali concrete.

Domande Frequenti sul Model Context Protocol (MCP)

Cos'è il Model Context Protocol (MCP) in parole semplici?

È una proposta (principalmente da Anthropic) per rendere più efficiente l'interazione con i grandi modelli linguistici (LLM). L'idea è di elaborare le informazioni di contesto (come lunghi documenti o chat precedenti) una sola volta e poi riutilizzare questo "stato contestuale" nelle interazioni successive, inviando solo i nuovi prompt. Questo evita di riprocessare tutto il contesto ogni volta, risparmiando costi e riducendo la latenza.

Quali sono i principali benefici attesi da MCP?

I benefici principali attesi sono:

Riduzione dei Costi: Meno calcoli significa costi inferiori per l'utilizzo delle API LLM.

Minore Latenza: Risposte più rapide grazie all'eliminazione del re-processing del contesto.

Migliore Scalabilità: Possibilità di gestire interazioni più lunghe e complesse in modo più sostenibile.

Potenziale per Nuove Applicazioni: Abilitare casi d'uso che oggi sono proibitivi per costi o latenza.

Model Context Protocol è uno standard ufficiale utilizzabile oggi?

No, allo stato attuale ([Anno Corrente]), MCP non sembra essere uno standard industriale ufficiale e ampiamente adottato. È principalmente una proposta avanzata da Anthropic, con alcuni vendor (come AWS) che stanno sviluppando soluzioni proprietarie che affrontano problemi simili. La definizione di un protocollo standard richiederà probabilmente ulteriore lavoro e collaborazione nel settore.

Come si confronta MCP con Retrieval-Augmented Generation (RAG)?

Sono concetti diversi ma potenzialmente complementari. RAG si occupa di recuperare le informazioni giuste da aggiungere al contesto del modello per una specifica domanda. MCP si occupa di gestire efficientemente quel contesto (che potrebbe includere dati recuperati da RAG) attraverso più interazioni, evitando di riprocessarlo. Si potrebbe usare RAG per trovare i dati e MCP per usarli efficientemente in una conversazione.

Chi trarrebbe maggior vantaggio dall'adozione di MCP?

Le organizzazioni e gli sviluppatori che costruiscono applicazioni AI caratterizzate da:

Interazioni conversazionali lunghe e complesse.

Analisi o riassunti di documenti molto estesi.

Utilizzo intensivo di LLM con finestre di contesto ampie.

Necessità di ottimizzare drasticamente i costi e la latenza dell'inferenza LLM su larga scala.

Il Model Context Protocol, o comunque l'idea fondamentale di una gestione più intelligente dello stato contestuale negli LLM, tocca una corda sensibile nell'evoluzione dell'Intelligenza Artificiale. Affronta un problema concreto la cui soluzione potrebbe sbloccare nuovi livelli di efficienza e potenzialità applicative. Tuttavia, come architetti digitali, il nostro compito è navigare queste acque con lucidità, distinguendo le promesse dalle realtà implementative e preparandoci strategicamente alle evoluzioni future, senza inseguire prematuramente ogni nuova sigla.

La vera architettura digitale risiede nella capacità di costruire sistemi resilienti, efficienti e adattabili, pronti a integrare le innovazioni significative quando queste dimostrano maturità e valore tangibile. MCP è sicuramente un'area da monitorare con estremo interesse.

Cosa ne pensate di questa analisi? State già affrontando le sfide del context processing nei vostri progetti AI? Qual è la vostra prospettiva sulle potenzialità e gli ostacoli di un approccio come MCP? Condividete le vostre riflessioni e le vostre esperienze nei commenti qui sotto. Il dialogo critico è essenziale per costruire insieme il futuro delle architetture digitali.